domingo, 4 de septiembre de 2016

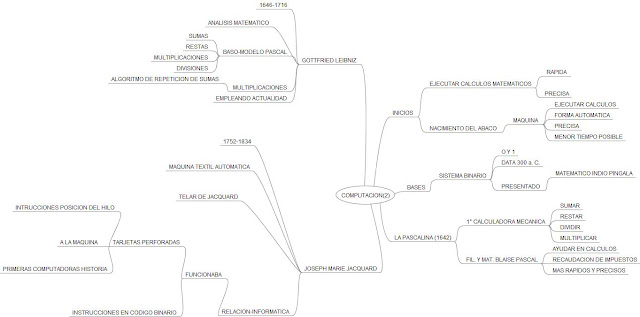

INFORMÁTICA I: MAPA MENTAL COMPUTACIÓN (4) 2016 PLANTEL EMSAD "LÁZARO CÁRDENAS"

NOTA. POR ERROR INVOLUNTARIO EL MAPA EN EL CENTRO DICE "COMPUTACIÓN 3" CUANDO SIGUIENDO LA SERIE ES COMPUTACIÓN (4), GRACIAS.

INFORMÁTICA I: MAPA MENTAL COMPUTACIÓN (3) 2016 PLANTEL EMSAD "LÁZARO CÁRDENAS"

NOTA: POR ERROR INVOLUNTARIO EN EL CENTRO DEL MAPA MENTAL DICE: COMPUTACIÓN (2) PERO EN REALIDAD TENDRÍA QUE DECIR COMPUTACIÓN (3) PORQUE VAN EN ORDEN 1,2,3... GRACIAS.

INFORMATICA I: EVOLUCIÓN DE LA MEMORIA RAM 2016 PLANTEL EMSAD "LÁZARO CÁRDENAS"

EVOLUCIÓN DE LA MEMORIA RAM

La memoria RAM originalmente

utilizada en computadoras basadas en el procesador 286 iba a la asombrosa

velocidad de 120ns (8.33Mhz), la cual era alrededor de doble la velocidad del

procesador. La memoria era instalada insertando chips individuales en ranuras

en la tarjeta madre para formar bancos de memoria; esto era muy incomodo, y

hacia que fuera muy fácil el accidentalmente dañar chips durante la

instalación.

La memoria RAM todavía era bastante cara en esa fecha (¡alrededor de 300

€ por 512KB de RAM!). Mientras que las originales IBM PC soportaban hasta 512KB

de memoria en la tarjeta madre, se le podía agregar mas utilizando una tarjeta

que se instalaba en una ranura ISA, en la cual se instalaban mas chips de

memoria. Uno duraba literalmente horas instalando un chip a la vez; otro

problema que se podía presentar con este método era que los chips tenían una

tendencia de salirse de sus ranuras con el calentamiento y enfriamiento a

través del tiempo. La única forma de evitar esto era soldando los chips a la

ranura, pero luego era casi imposible sacar los chips para actualizarlos o para

ver si estaban fallando.

SIMMs de 30 Pins

Las generaciones 386 y 486 de computadoras utilizaban versiones

mejoradas de RAM a 80ns (12.5Mhz), y venían en circuitos especiales llamados

“módulos”. Utilizando estos módulos de memoria simplificaba mucho el proceso de

instalación y desinstalación del sistema, aparte de ser mucho mas barato. Estos

módulos eran montados en ranuras en la tarjeta madre y eran fijados utilizando

unos clips con springs. El utilizar estos módulos preparados significaba

dedicarle menos espacio en la tarjeta madre para memoria, lo cual significaba

no solamente una tarjeta madre más pequeño en tamaño, sino también el sistema

completo era más pequeño. En caso de que fallara un modulo de memoria,

solamente tenias que quitarlo y poner otro; esto simplifico bastante el proceso

de mantenimiento y actualización.

Los módulos de memoria para las 386 y 486 tenían 30 pins, y eran

llamados SIMMs, lo que significa “Single Inline Memory Module”; los chips de

memoria se montaban en el módulo, y el módulo en si era instalado en la ranura

correspondiente en la tarjeta madre. La mayoría de las tarjetas madres tenían 8

ranuras de memoria en total, con 4 ranuras en cada banco. Para aumentar la

capacidad de memoria, simplemente tenias que instalar nuevos módulos en las

ranuras disponibles, o reemplazar módulos viejos con unos de mayor densidad.

Cada banco de memoria debe ser del mismo ancho que el bus del

procesador. Los 386s y 486s eran procesadores con bus de 32 bits; como cada

SIMM de 30 pins tenia 8 bits de ancho de banda (9 bits para módulos con

paridad), era requerido que uno instalara 4 chips a la vez para llenar un

banco. Uno tenia que llenar el banco, o sino el sistema no reconocería la

memoria; para colmo, la memoria debía de ser de la misma capacidad.

El aumento de 4Mhz entre memoria de 120ns y de 80ns era una mejora

decente, pero la memoria todavía era desesperadamente lenta comparada con la

velocidad del procesador, que para ese tiempo variaba desde 20Mhz hasta 120Mhz;

velocidades de las tarjetas madres iban desde 20Mhz hasta 66Mhz. La memoria

definitivamente representa un problema a la eficiencia del sistema. En los

sistemas anteriores basados en el 286, el bus del sistema iba a la misma

velocidad del procesador (aproximadamente 4.77Mhz); para ese tiempo, la

velocidad de 8.33Mhz de la memoria era mas que suficiente, pero con la llegada

del 386 y 486, se notaba mucho de que la velocidad del sistema y del procesador

estaban sacándole gabela a la memoria.

SIMMs de 72 pins

Con la salida del procesador Pentium trajo con el al bus PCI y a módulos

SIMMs de 72 pins. Estos nuevos SIMMs eran de 32 bits; estos módulos de 72 pins

llegaron a algunos 486 con tarjetas madres VLB (Vesa Local Bus) y PCI

(Peripheral Component Interconnect.)

Solamente dos módulos eran requeridos para llenar un banco en un sistema

Pentium, mientras que las 486 requerían de uno solo. Los dos chips instalados

en un banco de memoria deben de ser preferiblemente del mismo tipo, tamaño y

con el conector del mismo tipo (sea oro o cobre). No se podían ligar chips de

diferentes capacidades; simplemente el sistema o no funcionaría o el sistema

reduciría la capacidad del chip mayor al valor del menor (o sea que si uno

instalase un chip de 8MB y uno de 16MB, el sistema reconocería a 2 chips de

8MB.)

SO-DIMM

El “Small Outline-Dual Inline Memory Module” (SO-DIMM) fue creado

específicamente para aplicaciones móviles. Laptops en partículas son

extremadamente propietarias; si usted se fija en los catálogos de computadoras,

se pueden ver dos paginas dedicadas exclusivamente a las diferentes memorias de

laptops. La SO-DIMM fue creada con el fin de tratar de consolidar el tipo de

RAM utilizado en computadoras móviles. Cualquiera que tenga una laptop se ha

podido dar cuenta de los precios extraordinarios asociados con las laptops,

debido a que como el único suplidor de memoria para una laptop es el mismo

vendedor de ella, le pueden poner cualquier precio que deseen.

Actualmente los SO-DIMMs aparecen en configuraciones de 72, 100 y 144

pins. Estos módulos tienen trabajo en la mayoría de las aplicaciones móviles

que requieran RAM. Muchos de los SO-DIMMs son utilizados en impresoras.

DIMMs de 168 Pins

El “Dual Inline Memory Module” (DIMM) fue introducido con los últimos

modelos de sistemas Pentium MMX, y todavía se utiliza en la mayoría de los

sistemas actuales. DIMMs son módulos de memoria de 64 bits, y solamente se

requiere de un modulo para llenar un banco en el sistema.

Uno puede clasificar a la memoria EDO y la SDRAM (las cuales veremos

luego) como módulos DIMM. Los DIMMs vienen una en variedad de tipos, y tienen

un hoyito que, dependiendo de que lado esta, indica de que si esta es protegida

o no protegida; también tiene un indicador de voltaje, el cual especifica que

voltaje requiere para funcionar el chip (5V para memoria EDO, 3.3V para memoria

SDRAM).[1]

ARTICULO TOMADO DEL SIGUIENTE LINK PARA EFECTOS ACADÉMICOS

[1] http://www.hostingyvirtualizacion.com/evolucion-de-los-modulos-de-memoria-ram/

INFORMÁTICA I: GENERACIÓN DE COMPUTADORAS 2016 INVESTIGACIÓN PLANTEL EMSAD "LÁZARO CÁRDENAS"

INTRODUCCIÓN

En la

actualidad no se puede pensar en casi ninguna actividad en la cual no

intervengan de alguna manera los procesos de

cómputo. Las computadoras han

invadido la mayoría de las labores del ser humano

El mundo

está cambiando y usted deberá aprender todas esas, antes complicadas, hoy

comunes tecnologías modernas que le permitirán conseguir un empleo mejor

retribuido y quizás, en poco tiempo,

realizar trabajos desde la comodidad de su hogar (teletrabajo),

reduciendo el tráfico en las calles y por ende la contaminación de

las grandes ciudades. La mayoría de los gobiernos de los países en desarrollo han

tomado muy en serio los programas de educación para

crear en sus poblaciones una "cultura informática".

Definitivamente,

las computadoras están cambiando nuestras vidas. Ahora hemos de aprenderla para

no quedar inmersos en una nueva forma de analfabetismo.

Lo anterior contribuye a la creación de nuevos esquemas sociales que incluyen:

novedosas maneras de comercialización aprovechando

las facilidades para comunicarse con todo el mundo a través de Internet; la

necesidad de crear leyes adecuadas

a la realidad cibernética actual

y, sobre todo; la concepción de una nueva manera de relacionarse con nuestros

semejantes, que contemple una serie de normas éticas

que regulen la convivencia pacifica y cordial entre los millones de personas que

tienen que utilizar estas avanzadas tecnologías para realizar su trabajo,

estudio, descanso y esparcimiento diarios.

Hoy día

todos los habitantes del mundo somos dependientes directos o indirectos del uso

de las computadoras, como en oficinas bancarias, grandes y medianos comercios,

centros de enseñanza,

oficinas de ventas y

reservaciones para viajes,

clínicas médicas u hospitales, fabricas y almacenes industriales,

organismos de gobierno y

oficinas administrativas, laboratorios, y centros de investigación.

Estas máquinas maravillosas

inventadas por el hombre,

tal como ahora las concebimos, son el resultado de una secuencia de eventos que

el transcurso de esta investigación conoceremos.

Para

saber mas acerca de estos eventos en esta investigación mostraremos las

diferentes generaciones por las que ha pasado el mundo de la computación,

esta larga historia es

necesario mencionar las épocas y los personajes gracias a cuyos valiosos

aportes a través del tiempo, hicieron posible la gestación de la hoy llamada

Era de la Computación, la cual sin lugar a dudas es el resultado de un largo proceso evolutivo

que jamás cesará.

PRIMERA

GENERACIÓN (1951 a 1958)

Las

computadoras de la primera Generación emplearon bulbos para procesar información.

Los operadores ingresaban los datos y

programas en código especial

por medio de tarjetas perforadas.

El almacenamiento interno

se lograba con un tambor que giraba rápidamente, sobre el cual un dispositivo

de lectura/escritura colocaba marcas magnéticas.

Esas computadoras de bulbos eran mucho más grandes y generaban más calorque

los modelos contemporáneos.

Eckert y Mauchly contribuyeron al desarrollo de

computadoras de la 1era Generación formando una compañía privada y construyendo

UNIVAC I, que el Comité del censo utilizó para evaluar el censo de 1950. La IBM

tenía el monopolio de

los equipos de procesamiento de datos a base de tarjetas perforadas y estaba

teniendo un gran auge en productos como

rebanadores de carne, básculas para comestibles, relojes y otros artículos; sin

embargo no había logrado el contrato para

el Censo de 1950.

Comenzó

entonces a construir computadoras electrónicas y su primera entrada fue con la

IBM 701 en 1953. Después de un lento pero exitante comienzo la IBM 701 se

conviertió en un producto comercialmente

viable. Sin embargo en 1954 fue introducido el modelo IBM

650, el cual es la razón por la que IBM disfruta hoy de una gran parte del mercado de

las computadoras. La administración de

la IBM asumió un gran riesgo y

estimó una venta de

50 computadoras. Este número era mayor que la cantidad de computadoras

instaladas en esa época en E.U. De hecho la IBM instaló 1000 computadoras. El

resto es historia. Aunque caras y de uso limitado las computadoras fueron

aceptadas rápidamente por las Compañias privadas y de Gobierno. A la mitad de

los años 50 IBM y Remington Rand se consolidaban como líderes en la fabricación

de computadoras.

Transistor

Compatibilidad Limitada

El

invento del transistor hizo

posible una nueva Generación de computadoras, más rápidas, más pequeñas y con

menores necesidades de ventilación. Sin embargo el costo seguía

siendo una porción significativa del presupuesto de

una Compañía. Las computadoras de la segunda generación también utilizaban redes de núcleos

magnéticos en lugar de tambores giratorios para el almacenamiento primario.

Estos núcleos contenían pequeños anillos de material magnético, enlazados entre

sí, en los cuales podían almacenarse datos e instrucciones.

Los

programas de computadoras también mejoraron. El COBOL (COmmon

Busines Oriented Languaje) desarrollado durante la 1era generación estaba ya

disponible comercialmente, este representa uno de os mas grandes avances en

cuanto a portabilidad de programas entre diferentes computadoras; es decir, es

uno de los primeros programas que se pueden ejecutar en diversos equipos de

computo después de un sencillo procesamiento de compilación. Los programas

escritos para una computadora podían

transferirse a otra con un mínimo esfuerzo. Grace Murria Hooper (1906-1992),

quien en 1952 habia inventado el primer compilador fue una de las principales

figuras de CODASYL (Comité on Data SYstems Languages), que se encago de

desarrollar el proyecto COBOL

El escribir un programa ya

no requería entender plenamente el hardware de

la computación. Las computadoras de la 2da Generación eran sustancialmente más

pequeñas y rápidas que las de bulbos, y se usaban para nuevas aplicaciones,

como en los sistemas para

reservación en líneas aéreas, control de

tráfico aéreo y simulaciones para uso general. Las empresas comenzaron

a aplicar las computadoras a tareas de almacenamiento de registros,

como manejo de inventarios, nómina y contabilidad.

La

marina de E.U. utilizó las computadoras de la Segunda Generación para crear el

primer simulador de vuelo. (Whirlwind I). HoneyWell se colocó como el primer

competidor durante la segunda generación de computadoras. Burroughs, Univac,

NCR, CDC, HoneyWell, los más grandes competidores de IBM durante los 60s se

conocieron como el grupo BUNCH.

Algunas

de las computadoras que se construyeron ya con transistores fueron

la IBM 1401, las Honeywell 800 y su serie 5000, UNIVAC M460, las IBM 7090 y

7094, NCR 315, las RCA 501 y 601, Control Data Corporation con su conocido

modelo CDC16O4, y muchas otras, que constituían un mercado de gran competencia,

en rápido crecimiento. En esta generación se construyen las supercomputadoras

Remington Rand UNIVAC LARC, e IBM Stretch (1961).

Circuitos

Integrados, Compatibilidad con Equipo Mayor, Multiprogramación, Minicomputadora.

Las

computadoras de la tercera generación emergieron con el desarrollo de los circuitos integrados

(pastillas de silicio) en las cuales se colocan miles de componentes electrónicos,

en una integración en

miniatura. Las computadoras nuevamente se hicieron más pequeñas, más rápidas,

desprendían menos calor y eran energéticamente más eficientes.

El descubrimiento

en 1958 del primer Circuito Integrado (Chip) por el ingeniero Jack S. Kilby

(nacido en 1928) de Texas Instruments, así como los trabajos que realizaba, por

su parte, el Dr. Robert Noyce de Fairchild Semicon ductors, acerca de los

circuitos integrados, dieron origen a la tercera generación de computadoras.

Antes del

advenimiento de los circuitos

integrados, las computadoras estaban diseñadas para aplicaciones matemáticas o

de negocios,

pero no para las dos cosas. Los circuitos integrados permitieron a los fabricantes

de computadoras incrementar la flexibilidad de los programas, y estandarizar

sus modelos.

La IBM

360 una de las primeras computadoras comerciales que usó circuitos integrados,

podía realizar tanto análisis numéricos

como administración ó

procesamiento de archivos.

IBM marca el

inicio de esta generación, cuando el 7 de abril de 1964 presenta la

impresionante IBM 360, con su tecnología SLT

(Solid Logic Technology). Esta máquina causó tal impacto en el mundo de la

computación que se fabricaron más de

30000, al

grado que IBM llegó a conocerse como sinónimo de computación.

También

en ese año, Control Data Corporation presenta la supercomputadora CDC 6600, que

se consideró como la más poderosa de las computadoras de la época, ya que tenía

la capacidad de ejecutar unos 3 000 000 de instrucciones por segundo (mips).

Se

empiezan a utilizar los medios magnéticos

de almacenamiento, como cintas magnéticas de 9 canales, enormes discos rígidos,

etc. Algunos sistemas todavía usan las tarjetas perforadas para la entrada de

datos, pero las lectoras de tarjetas ya alcanzan velocidades respetables.

Los clientes podían

escalar sus sistemas 360 a modelos IBM de mayor tamaño y podían todavía correr

sus programas actuales. Las computadoras trabajaban a tal velocidad que

proporcionaban la capacidad de correr más de un programa de manera simultánea

(multiprogramación).

Por

ejemplo la

computadora podía estar calculando la nomina y aceptando

pedidos al mismo tiempo. Minicomputadoras, Con la introducción del

modelo 360 IBM acaparó el 70% del mercado, para evitar competir directamente

con IBM la empresa Digital

Equipment Corporation DEC redirigió sus esfuerzos hacia computadoras pequeñas.

Mucho menos costosas de comprar y de operar que las computadoras grandes, las

minicomputadoras se desarrollaron durante la segunda generación pero alcanzaron

sumador auge entre 1960 y 70.

Microprocesador

, Chips de memoria,

Microminiaturización

Dos

mejoras en la tecnología de las computadoras marcan el inicio de la cuarta

generación: el reemplazo de las memorias con

núcleos magnéticos, por las de chips de silicio y la colocación de Muchos más

componentes en un Chip: producto de la microminiaturización de los circuitos

electrónicos. El tamaño reducido del microprocesador y

de chips hizo posible la creación de las computadoras personales (PC)

En 1971,

intel Corporation, que era una pequeña compañía fabricante de semiconductores ubicada

en Silicon Valley, presenta el primer microprocesador o Chip de 4 bits, que en

un espacio de aproximadamente 4 x 5 mm contenía 2 250 transistores. Este primer

microprocesador que se muestra en

la figura 1.14, fue bautizado como el 4004.

Silicon

Valley (Valle del Silicio) era una región agrícola al sur de la bahía de San

Francisco, que por su gran producción de

silicio, a partir de 1960 se convierte en una zona totalmente industrializada

donde se asienta una gran cantidad de empresas fabricantes de semiconductores y microprocesadores.

Actualmente es conocida en todo el mundo como la región más importante para las industrias relativas

a la computación: creación de programas y fabricación de componentes.

Actualmente

ha surgido una enorme cantidad de fabricantes de microcomputadoras o

computadoras personales, que utilizando diferentes estructuras o

arquitecturas se pelean literalmente por el mercado de la computación, el cual

ha llegado a crecer tanto que es uno de los más grandes a nivel mundial; sobre

todo, a partir de 1990, cuando se logran sorprendentes avances en Internet.

Esta

generación de computadoras se caracterizó por grandes avances tecnológicos

realizados en un tiempo muy corto. En 1977 aparecen las primeras

microcomputadoras, entre las cuales, las más famosas fueron las fabricadas por

Apple Computer, Radio Shack

y Commodore Busíness

Machines. IBM se integra al mercado de las microcomputadoras con su Personal Computer

(figura 1.15), de donde les ha quedado como sinónimo el nombre de PC, y lo más

importante; se incluye un sistema

operativo estandarizado, el MS- DOS (MicroSoft Disk

Operating System).

Las

principales tecnologías que dominan este mercado son:

IBM y sus

compatibles llamadas clones, fabricadas por infinidad de compañías con base en

los procesadores 8088,

8086, 80286, 80386, 80486, 80586 o Pentium,

Pentium II, Pentium III y Celeron de Intel y en segundo término Apple Computer,

con sus Macintosh y las Power Macintosh, que tienen gran capacidad de

generación de gráficos y

sonidos gracias a sus poderosos procesadores Motorola serie 68000 y PowerPC,

respectivamente. Este último microprocesador ha sido fabricado utilizando la

tecnología RISC (Reduced Instruc tion Set Computing), por Apple Computer Inc.,

Motorola Inc. e IBM Corporation, conjuntamente.

Los

sistemas operativos han alcanzado un notable desarrollo, sobre todo por la

posibilidad de generar gráficos a gran des velocidades, lo cual permite

utilizar las interfaces gráficas de

usuario (Graphic User Interface, GUI), que son pantallas con ventanas, iconos

(figuras) y menús desplegables que facilitan las tareas de comunicación entre

el usuario y la computadora, tales como la selección de comandos del sistema operativo

para realizar operaciones de

copiado o formato con una simple pulsación de cualquier botón del ratón (mouse)

sobre uno de los iconos o menús.

Cada vez

se hace más difícil la identificación de las generaciones de computadoras,

porque los grandes avances y nuevos descubrimientos ya no nos sorprenden como

sucedió a mediados del siglo XX. Hay quienes consideran que la cuarta y quinta

generación han terminado, y las ubican entre los años 1971-1984 la cuarta, y

entre 1984-1990 la quinta. Ellos consideran que la sexta generación está en

desarrollo desde 1990 hasta la fecha.

Siguiendo

la pista a los acontecimientos tecnológicos en materia de

computación e informática, podemos puntualizar algunas fechas y características

de lo que podría ser la quinta generación de computadoras.

Con base

en los grandes acontecimientos tecnológicos en materia de microelectrónica y

computación (software)

como CADI CAM, CAE, CASE, inteligencia artificial, sistemas expertos, redes

neuronales, teoría del

caos, algoritmos genéticos,

fibras ópticas, telecomunicaciones,

etc., a de la década de los años ochenta se establecieron las bases de lo que

se puede conocer como quinta generación de computadoras.

Hay que

mencionar dos grandes avances tecnológicos, que sirvan como parámetro para el

inicio de dicha generación: la creación en 1982 de la primera supercomputadora

con capacidad de proceso paralelo, diseñada por Seymouy Cray, quien ya

experimentaba desde 1968 con supercomputadoras, y que funda en 1976 la Cray

Research Inc.; y el anuncio por parte del gobierno japonés del proyecto

"quinta generación", que según se estableció en el acuerdo con seis

de las más grandes empresas japonesas de computación, debería terminar en 1992.

El proceso

paralelo es aquél que se lleva a cabo en computadoras que tienen la capacidad

de trabajar simultáneamente con varios microprocesadores. Aunque en teoría el trabajo con

varios microprocesadores debería ser mucho más rápido, es necesario llevar a

cabo una programación especial

que permita asignar diferentes tareas de un mismo proceso a los diversos

microprocesadores que intervienen.

También

se debe adecuar la memoria para

que pueda atender los requerimientos de los procesadores al mismo tiempo. Para

solucionar este problema se tuvieron que diseñar módulos de memoria compartida

capaces de asignar áreas de caché para cada procesador.

El

almacenamiento de información se realiza en dispositivos magneto ópticos con

capacidades de decenas de Gigabytes; se establece el DVD (Digital Video Disk

o Digital Versatile Disk) como estándar para el almacenamiento de video y sonido;

la capacidad de almacenamiento de datos crece de manera exponencial

posibilitando guardar más información en una de estas unidades, que toda la que

había en la Biblioteca de

Alejandría. Los componentes de los microprocesadores actuales utilizan

tecnologías de alta y ultra integración, denominadas VLSI (Very Large Sca/e

Integration) y ULSI (Ultra Lar- ge Scale Integration).

Sin

embargo, independientemente de estos "milagros" de la tecnología

moderna, no se distingue la brecha donde finaliza la quinta y comienza la sexta

generación. Personalmente, no hemos visto la realización cabal de lo expuesto

en el proyecto japonés debido al fracaso, quizás momentáneo, de la inteligencia

artificial.

El

propósito de la Inteligencia Artificial es equipar a las Computadoras con

"Inteligencia Humana" y con la capacidad de razonar para

encontrar soluciones.

Otro factor fundamental del diseño,

la capacidad de la Computadora para reconocer patrones y secuencias de

procesamiento que haya encontrado previamente, (programación Heurística) que

permita a la Computadora recordar resultados previos e incluirlos en el

procesamiento, en esencia, la Computadora aprenderá a partir de sus propias

experiencias usará sus Datos originales para obtener la respuesta por medio del

razonamiento y conservará esos resultados para posteriores tareas de

procesamiento y toma de decisiones.

Como

supuestamente la sexta generación de computadoras está en marcha desde principios de

los años noventas, debemos por lo menos, esbozar las características que deben

tener las computadoras de esta generación. También se mencionan algunos de

los avances

tecnológicos de la última década del siglo XX y lo que se

espera lograr en el siglo XXI. Las computadoras de esta generación cuentan con

arquitecturas combinadas Paralelo / Vectorial, con cientos de microprocesadores

vectoriales trabajando al mismo tiempo; se han creado computadoras capaces de

realizar más de un millón de millones de operaciones aritméticas de punto

flotante por segundo (teraflops); las redes de área mundial (Wide Area Network,

WAN) seguirán creciendo desorbitadamente utilizando medios de comunicación a

través de fibras ópticas y satélites,

con anchos de banda impresionantes. Las tecnologías de esta generación ya han

sido desarrolla das o están en ese proceso. Algunas de ellas son: inteligencia

/ artificial distribuida; teoría del caos, sistemas difusos, holografía,

transistores ópticos, etcétera.

En esta

investigación acerca de las generaciones de las computadoras nos hemos dado

cuenta del avance que han tenidos y , gracias a los avances en relación a ellas

hemos alcanzado un nivel de tecnología muy elevado el cual nos ha servido para

muchas áreas, como por ejemplo las comunicaciones,

la medicina,

la educación, etc.

La

investigación actual va dirigida a aumentar la velocidad y capacidad de las

computadoras se centra sobre todo en la mejora de la tecnología de los

circuitos integrados y en el desarrollo de componentes de conmutación aún más

rápidos. Se han construido circuitos integrados a gran escala que

contienen varios millones de componentes en un solo chip.

Las

computadoras se han convertido en la principal herramienta utilizada por

el hombre y

ya son parte esencial de cada uno de nosotros, y usted deberá aprender todas

esas, antes complicadas hoy comunes tecnologías modernas.[1]

ESTE TRABAJO FUE TOMADO DEL SIGUIENTE LINK:

Leer más: http://www.monografias.com/trabajos28/generaciones-computadoras/generaciones-computadoras.shtml#ixzz4JLEIFNbO

Leer más: http://www.monografias.com/trabajos28/generaciones-computadoras/generaciones-computadoras.shtml#ixzz4JLEIFNbO

INFORMÁTICA I "ALAN MATHISON TURING" 2016. PLANTEL EMSAD LÁZARO CÁRDENAS 21EMS0026S

Alan Turing

Alan

Mathison Turing (Londres, 1912- Wilmslow, Reino Unido, 1954) es considerado una

de las piezas clave en el mundo de la computación, además de contribuir

decisivamente en campos como la informática teórica y la criptografía. Entre

sus más destacables hitos científicos encontramos: la función calculable, la

máquina de Turing, el pre-desarrollo de la computadora Colossus, la

desencriptadora Bombe, la prueba sobre inteligencia artificial, además de un

largo etcétera de aportaciones conceptuales y técnicas para el desarrollo de la

ciencia.

El matemático británico pasó gran parte de su infancia en la India dado que su padre tenía el lugar de trabajo en la Administración Colonial del país. Desde muy pequeño, Turing mostró un gran interés por la lectura, los números y los rompecabezas; sus ansias de conocimiento y experimentación llegaban hasta tal punto que a los ocho años, atraído por la química, diseñó un pequeño laboratorio en su casa. Su carrera escolar estuvo marcada, por un lado, por sus aptitudes y su facilidad por las matemáticas y, por el otro, por su carácter inconformista que le llevaba a seguir sus propias ideas y apartarse del rígido (e ilógico, según su parecer) sistema educativo. Como curiosidad, cabe decir que Turing recorría alrededor de 90 kilómetros para poder ir a la escuela, dato que nos hace entender como, más adelante, además de científico, fue un atleta notable de rango casi olímpico. En la escuela de Sherbone, ganó la mayor parte de los premios matemáticos que se otorgaban y, además, realizaba experimentos químicos por su cuenta aunque la opinión del profesorado respecto a la independencia y ambición de Turing no era demasiado favorable. Con poco más de quince años, entró en contacto con el trabajo de Albert Einstein y, además de entender sus bases, comprendió las críticas de éste a las Leyes de Newton a partir de un texto en el que no se explicitaba tal cometido.

En 1934, Turing se graduó en la Licenciatura de Matemáticas en la Universidad de Cambridge y, en 1936 publicó el artículo "Los números computables, con una aplicación al Entscheidungsproblem" en el que ya hablaba del concepto de algoritmo y exponía las bases de su máquina de calcular: la Máquina Universal (de Turing). La base de ésta máquina ficticia -no se llegó a diseñar- es la posibilidad de aceptar programas finitos de longitud arbitraria, es decir, limitar y simplificar las posibilidades numéricas, función que no podían realizar las máquinas de calcular del momento. La máquina de Turing podía llevar a cabo todo tipo de operaciones con la misma lógica que el cálculo humano a partir de ciertas bases como tener un número finito de símbolos, resultados o instrucciones. La máquina consta de un aparato de lectura y escritura ante el cual se desplaza, en ambas direcciones, una cinta potencialmente infinita dividida en casillas. La máquina puede encontrarse en un estado pasivo (finito) o activo (infinito). En su funcionamiento, dado un estado activo y una determinada inscripción de la cinta, la máquina realiza una acción elemental y, si el resultado vuelve a ser activo, la máquina actúa de nuevo hasta alcanzar un estado pasivo. La puesta en práctica de la Máquina Turing no fue posible hasta sus trabajos posteriores durante la Segunda Guerra mundial.

Después de su estancia entre los años 1937 y 1938 en la Universidad de Princeton en Nueva Jersey, obtuvo el Doctorado y anunció el concepto de hipercomputación, que tomaba como base la Máquina Universal y preludiaba una nueva "máquina oráculo" que permitiera el estudio de problemas cuya solución algorítmica no existiera. Entre 1938 y 1939 volvió a Inglaterra y estudió filosofía de las matemáticas. Su carrera profesional dio un salto con la llegada de la Segunda Guerra Mundial gracias a su trabajo como criptógrafo en una división de la Inteligencia británica. El ejército precisó de la labor de Turing para poder combatir contra el bando alemán a partir de descifrar los códigos que su Marina emitía con la máquina Enigma y los codificadores de teletipos FISH. El resultado del trabajo capitaneado por Turing fue la máquina descifradora Bombey varias computadoras electrónicas Colossus, consideradas, para algunos, los primeros ordenadores de la historia y, por lo tanto, el inicio de la informática y además, un paso que marcó el curso del conflicto bélico. La función de la máquina electromecánica Bombe era eliminar las claves enigma candidatas y se convirtió en el instrumento básico de los aliados para leer las transmisiones de la Enigma. Para ello, se implementaba eléctricamente una cadena de deducciones lógicas para cada combinación posible del código de modo que se podía detectar cuando ocurría una contradicción y desechar la combinación. Debido a la importancia de su trabajo, Turing recibió, en el año 1946, la Orden del Imperio británico (otorgada a aquellos que han hecho algo significativo para el Reino Unido). Tal fue la relevancia y secretismo de la ruptura de códigos de Turing que sus trabajos no han sido publicados hasta los años 70.

Después de ser contratado por el Laboratorio Nacional de Física (NLP) para competir con un proyecto americano, Turing se convirtió en el Oficial Científico Principal en la Automatic Computing Engine. Su estancia en la ACE dio sus frutos con conceptos como las redes de cómputo, la subrutina y la biblioteca de software además de constituir las bases de la red neuronal. Al abandonar, en 1948, la NLP, el trabajo de Alan Turing se dirigió hacia el campo de investigación de la Inteligencia Artificial, de hecho, el concepto en sí de esta disciplina nació de la mano de Turing. Anteriormente, habían surgido algunas teorías sobre la Inteligencia Artificial, pero no fue hasta la aportación de Turing que esta rama de la ciencia alcanzó la repercusión que puede tener hoy en día. En un artículo publicado por él en el año 1950, "Computing Machinery and Inteligence", Turing apuntaba el hecho de sí las máquinas pueden pensar o no. Para sacar conclusiones sobre ello, el matemático desarrolló el Test de Turing con el que trataba de reafirmar la existencia de la inteligencia en las máquinas. Su argumentación para encauzarse en este estudio se basaba en el hecho de que si una máquina se comporta como inteligente, en consecuencia, debe ser inteligente. Por lo tanto, existe Inteligencia Artificial en el momento en el que no logramos distinguir entre un ser humano y una máquina. El desafío de la prueba de Turing se efectuaba con dos personas y una computadora: en una habitación se ubicaba a una persona, el juez, y en la otra la persona restante y la máquina. El juez, que emitía preguntas tanto al ordenador como a la persona, debía descubrir cual era el ser humano y cual era el ordenador a partir de sus respuestas. La prueba consistía en ver cual de ambos sabía mentir mejor a las respuestas del juez para que éste no pudiera distinguir quién era la máquina y quién el hombre. Con este método se observaba si la máquina podía engañar al interrogador y por lo tanto pasar el Test de Turing. Aunque a nivel práctico, no obtuvo el éxito esperado, el diseño de la prueba desencadenó múltiples respuestas teóricas.

Por otro lado, desde 1952, Turing se centró en otra materia: la biología matemática. Su trabajo fue recogido en el libro "Fundamentos Químicos de la Morfogénesis" y estaba enfocado en analizar la existencia de los números de Fibonacci -sucesión de cifras que está presente en la naturaleza de forma estable- en las estructuras vegetales.

La vasta carrera de Turing se vio deteriorada por cuestiones personales. La "condición" de homosexual del matemático le llevó a ser condenado ya que en ese momento, en Inglaterra, se concebía como un delito. Ante la opción de ir a la cárcel o someterse a una castración química, Turing optó por la segunda, que le provocó trastornos físicos y en consecuencia, psicológicos. En 1954, con tan solo 42 años, Alan Turing murió envenenado con una manzana recubierta de cianuro -algunos apuntan cierta relación con manzana mordida del logotipo de Apple. Muchas son las hipótesis acerca de su fallecimiento (muerte involuntaria, asesinato, suicidio) pero lo que sí es cierto es que, una vez más, la historia demostró la incongruencia del ser humano y, con ello, la pérdida de un gran profesional que aportó conceptos clave para el desarrollo de la ciencia.[1]

FUENTES DE INFORMACIÓN

Bibliografía:

Gran Enciclopedia Larousse - Tomo 23. Ed. Planeta.

El matemático británico pasó gran parte de su infancia en la India dado que su padre tenía el lugar de trabajo en la Administración Colonial del país. Desde muy pequeño, Turing mostró un gran interés por la lectura, los números y los rompecabezas; sus ansias de conocimiento y experimentación llegaban hasta tal punto que a los ocho años, atraído por la química, diseñó un pequeño laboratorio en su casa. Su carrera escolar estuvo marcada, por un lado, por sus aptitudes y su facilidad por las matemáticas y, por el otro, por su carácter inconformista que le llevaba a seguir sus propias ideas y apartarse del rígido (e ilógico, según su parecer) sistema educativo. Como curiosidad, cabe decir que Turing recorría alrededor de 90 kilómetros para poder ir a la escuela, dato que nos hace entender como, más adelante, además de científico, fue un atleta notable de rango casi olímpico. En la escuela de Sherbone, ganó la mayor parte de los premios matemáticos que se otorgaban y, además, realizaba experimentos químicos por su cuenta aunque la opinión del profesorado respecto a la independencia y ambición de Turing no era demasiado favorable. Con poco más de quince años, entró en contacto con el trabajo de Albert Einstein y, además de entender sus bases, comprendió las críticas de éste a las Leyes de Newton a partir de un texto en el que no se explicitaba tal cometido.

En 1934, Turing se graduó en la Licenciatura de Matemáticas en la Universidad de Cambridge y, en 1936 publicó el artículo "Los números computables, con una aplicación al Entscheidungsproblem" en el que ya hablaba del concepto de algoritmo y exponía las bases de su máquina de calcular: la Máquina Universal (de Turing). La base de ésta máquina ficticia -no se llegó a diseñar- es la posibilidad de aceptar programas finitos de longitud arbitraria, es decir, limitar y simplificar las posibilidades numéricas, función que no podían realizar las máquinas de calcular del momento. La máquina de Turing podía llevar a cabo todo tipo de operaciones con la misma lógica que el cálculo humano a partir de ciertas bases como tener un número finito de símbolos, resultados o instrucciones. La máquina consta de un aparato de lectura y escritura ante el cual se desplaza, en ambas direcciones, una cinta potencialmente infinita dividida en casillas. La máquina puede encontrarse en un estado pasivo (finito) o activo (infinito). En su funcionamiento, dado un estado activo y una determinada inscripción de la cinta, la máquina realiza una acción elemental y, si el resultado vuelve a ser activo, la máquina actúa de nuevo hasta alcanzar un estado pasivo. La puesta en práctica de la Máquina Turing no fue posible hasta sus trabajos posteriores durante la Segunda Guerra mundial.

Después de su estancia entre los años 1937 y 1938 en la Universidad de Princeton en Nueva Jersey, obtuvo el Doctorado y anunció el concepto de hipercomputación, que tomaba como base la Máquina Universal y preludiaba una nueva "máquina oráculo" que permitiera el estudio de problemas cuya solución algorítmica no existiera. Entre 1938 y 1939 volvió a Inglaterra y estudió filosofía de las matemáticas. Su carrera profesional dio un salto con la llegada de la Segunda Guerra Mundial gracias a su trabajo como criptógrafo en una división de la Inteligencia británica. El ejército precisó de la labor de Turing para poder combatir contra el bando alemán a partir de descifrar los códigos que su Marina emitía con la máquina Enigma y los codificadores de teletipos FISH. El resultado del trabajo capitaneado por Turing fue la máquina descifradora Bombey varias computadoras electrónicas Colossus, consideradas, para algunos, los primeros ordenadores de la historia y, por lo tanto, el inicio de la informática y además, un paso que marcó el curso del conflicto bélico. La función de la máquina electromecánica Bombe era eliminar las claves enigma candidatas y se convirtió en el instrumento básico de los aliados para leer las transmisiones de la Enigma. Para ello, se implementaba eléctricamente una cadena de deducciones lógicas para cada combinación posible del código de modo que se podía detectar cuando ocurría una contradicción y desechar la combinación. Debido a la importancia de su trabajo, Turing recibió, en el año 1946, la Orden del Imperio británico (otorgada a aquellos que han hecho algo significativo para el Reino Unido). Tal fue la relevancia y secretismo de la ruptura de códigos de Turing que sus trabajos no han sido publicados hasta los años 70.

Después de ser contratado por el Laboratorio Nacional de Física (NLP) para competir con un proyecto americano, Turing se convirtió en el Oficial Científico Principal en la Automatic Computing Engine. Su estancia en la ACE dio sus frutos con conceptos como las redes de cómputo, la subrutina y la biblioteca de software además de constituir las bases de la red neuronal. Al abandonar, en 1948, la NLP, el trabajo de Alan Turing se dirigió hacia el campo de investigación de la Inteligencia Artificial, de hecho, el concepto en sí de esta disciplina nació de la mano de Turing. Anteriormente, habían surgido algunas teorías sobre la Inteligencia Artificial, pero no fue hasta la aportación de Turing que esta rama de la ciencia alcanzó la repercusión que puede tener hoy en día. En un artículo publicado por él en el año 1950, "Computing Machinery and Inteligence", Turing apuntaba el hecho de sí las máquinas pueden pensar o no. Para sacar conclusiones sobre ello, el matemático desarrolló el Test de Turing con el que trataba de reafirmar la existencia de la inteligencia en las máquinas. Su argumentación para encauzarse en este estudio se basaba en el hecho de que si una máquina se comporta como inteligente, en consecuencia, debe ser inteligente. Por lo tanto, existe Inteligencia Artificial en el momento en el que no logramos distinguir entre un ser humano y una máquina. El desafío de la prueba de Turing se efectuaba con dos personas y una computadora: en una habitación se ubicaba a una persona, el juez, y en la otra la persona restante y la máquina. El juez, que emitía preguntas tanto al ordenador como a la persona, debía descubrir cual era el ser humano y cual era el ordenador a partir de sus respuestas. La prueba consistía en ver cual de ambos sabía mentir mejor a las respuestas del juez para que éste no pudiera distinguir quién era la máquina y quién el hombre. Con este método se observaba si la máquina podía engañar al interrogador y por lo tanto pasar el Test de Turing. Aunque a nivel práctico, no obtuvo el éxito esperado, el diseño de la prueba desencadenó múltiples respuestas teóricas.

Por otro lado, desde 1952, Turing se centró en otra materia: la biología matemática. Su trabajo fue recogido en el libro "Fundamentos Químicos de la Morfogénesis" y estaba enfocado en analizar la existencia de los números de Fibonacci -sucesión de cifras que está presente en la naturaleza de forma estable- en las estructuras vegetales.

La vasta carrera de Turing se vio deteriorada por cuestiones personales. La "condición" de homosexual del matemático le llevó a ser condenado ya que en ese momento, en Inglaterra, se concebía como un delito. Ante la opción de ir a la cárcel o someterse a una castración química, Turing optó por la segunda, que le provocó trastornos físicos y en consecuencia, psicológicos. En 1954, con tan solo 42 años, Alan Turing murió envenenado con una manzana recubierta de cianuro -algunos apuntan cierta relación con manzana mordida del logotipo de Apple. Muchas son las hipótesis acerca de su fallecimiento (muerte involuntaria, asesinato, suicidio) pero lo que sí es cierto es que, una vez más, la historia demostró la incongruencia del ser humano y, con ello, la pérdida de un gran profesional que aportó conceptos clave para el desarrollo de la ciencia.[1]

FUENTES DE INFORMACIÓN

Bibliografía:

Gran Enciclopedia Larousse - Tomo 23. Ed. Planeta.

Suscribirse a:

Comentarios (Atom)